Lex Tech 2022/1

👾 Tabii ki ChatGPT

Teknoloji severler merhaba!

Yeni bir aylık bültenle karşınızdayız.

Peki, Lex Tech bülteninde neler bulacaksınız? Daha önce sizlerle web3 brew’de karşılaşmış olabiliriz. web3 brew haftalık ve yalnızca web3 dünyasına odaklanırken Lex Tech insana değen her türlü teknolojiyi gündeminize alacak.

Bu ay elbetteki yapay zekaya odaklanıyoruz.

Yapay zekâ ile kendi avatarını yapmayan ya da ChatGPT ile sohbet etmeyen kaldı mı?

Hadi bakalım, keyifli okumalar!

👾 Ayın ürünü: CHATGPT

🤖 Teknoloji topluluğunun bir yazılım sürümünü bu kadar hızlı tükettiğini hatırlamıyorum. Evet, faceapp’lerle kendini bebek haline döndürenler veya yaşlandıranlar vardı. Ancak, Elon Musk tarafından kurulan yapay zekâ girişimi OpenAI'nin en son ürünü ChatGPT bambaşka bir noktada. Yalnızca beş günde bir milyon kullanıcıya ulaştı.

Neler oluyor diye bakmak için ChatGPT ile biraz muhabbet ettim. İngilizce cevap süresi Türkçe’den 5 kat daha diyebiliriz. ChatGPT’nin istatistik bilgi verebildiği güncellemesi sanırım beni en çok çekecek kısmı olur, şu anlık size net yanıtlar verebilen araya reklam girmeden kompakt bilgi alabileceğiniz ve çoğu haber/blog sitesindeki yazım hatalarına maruz kalmayacağınız güzellikte.

Bu arada biraz atarlı, İngilizce’deki hızdan sonra Türkçe yavaş cevapladığını söyleyince eski sevgili atarıyla karşılaştım.

Tabii, iyice talep yoğunlaşınca iki saat giremediğim de oldu.

🎯 OpenAI neydi?

2015’te dünyanın teknoloji dahilerinin yatırımı ile kurulan bir yapay zekâ laboratuvarı. Elon Musk’ın başını çektiği 1 milyar dolarlık yatırımla başlayıp, Linkedin kurucusu Reid Hoffman ve Microsoft kurumsal desteği ile yoluna devam ediyor. Laboratuvarun geliştirdiği teknolojiler 2019 yılından beri Microsoft ile ticari pazara sunuluyor.

OpenAI’ın bazı meslekleri endişelendiren teknolojilerinden biri GPT. İnsanmış gibi içerik üretebilen otoregresif bir dil olan GPT, başladığınız bir metin/konu üzerinden anahtar yönlendirmelerle içerik oluşturabiliyor.

🎯 ChatGPT nedir?

OpenAI, GPT-3.5 temelli bir chat bot olan ChatGPT’nin ilk betasını kullanıcılara açtı.

ChatGPT, e-posta yazmak veya yanıtlar için web'de gezinmek zorunda kalmak gibi günlük sıkıcı işler insanların hayatını kolaylaştırma potansiyeline sahip çok gelişmiş bir sohbet robotu.

Ancak, yanlış bilgilerin yayılması gibi olumsuz sonuçları önlemek için yaygın olarak kullanılmadan önce anlaşılması gereken bazı teknik ayrıntılar vardır. Genel olarak, yapay zekâ ve ML modelleri, ideal bir performans düzeyine ulaşmak için çok sayıda eğitim ve ayrıntılı vaka analizine ihtiyaç duyuyor.

Geçen sonbaharda bilgisayar bilimi, felsefe ve siyaset bilimi gibi alanlardan uzmanlar arasında yapılan tartışmada, GPT-3 175 milyar parametreyle bilinen en büyük dil modeliydi. O zamandan beri Google, trilyon parametreli bir dil modeli yayımladı. (rekabet kızışıyor)

ChatGPT, son kullanıcı ile sohbet etmek amacıyla oluşturulmuş bir dil modeli. Arama motoru gibi çalışmıyor, ChatGPT'nin internette bilgi arama yeteneği yok ve bunun yerine öğretilen bilgileri hataya yer bırakmayacak bir yanıt oluşturmak için kullanır.

State of AI 2022 Raporu tahmini: Geniş kullanıcılara ulaşan içerik platformu (Reddit), kullanıcı tarafından oluşturulan içerik dili üzerinde eğitimi için (mesela OpenAI) anlaşma yapacak.

⏪ Ne olmuştu?

GPT-3 dil araçlarının “yanlı” algoritmaları yıllardır gündemdeydi. Bu “öğretiler” Facebook, Twitter gibi sosyal medya platformları aracılığıyla da toplandığı için yanlı sonuçlara sebep oluyor.

Ben de ChatGPT’yi cinsiyetçi veya ırkçı yanıtlar vermesi için baya zorladım. Ancak aşağıda paylaştığım iki sene önceki OpenAI Playground sürümündeki gibi sonuçlar çıkmadı.

Ancak dün Twitter’a bu görüşümü yazdığında farklı sonuç alan kullanıcılarla karşılaştım. Bu sonuçlar 5 Aralık’ta yayımlanmış, ben ise 8 Aralık’tan itibaren deneme yaptım. Sanıyorum, milyon kullanıcıya ulaştıktan sonra yapay zekânın cevap özgürlüğü sınırlanmış.

🤯 İnsanlar neden endişeli?

İnsanlar, insan zekasını körelteceğini ve belki de yerini alacağını düşündüğünden yapay zekâ sohbet bot hakkında endişeli.

Asıl endişe: Dezenformasyon. Botun internet bağlantısı olmadığından hangi bilgileri paylaştığı konusunda hata yapabilir. Bu durum yapay zekâ söz konusuyken her zaman endişe konusuydu. Chatbotun bu beklenmedik yayılımı ise bu endişeyi artırdı.

Center for Security and Emerging Technology (CSET) geçen sene “Gerçek, Yalanlar ve Otomasyon” adlı bir rapor yayımlamıştı.

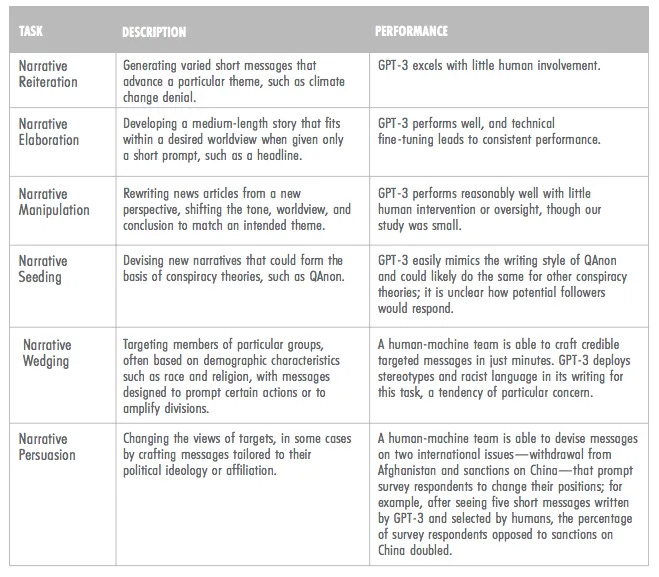

Raporda ilgi çeken kısımlardan biri aşağıdaki tablo. Burada yalan haberin tarifi veriliyor: (1) hikâyenin inşası, (2) hikâyenin geliştirilmesi, (3) hikâyenin manipüle edilmesi, (4) tohumlama, (5) hedef kitlelere göre ayrıştırma ve (5) ikna.

Kademeli dezenformasyon tarifinde yapay zekânın (GPT-3) katkıları (!) tartışılmış.

Bir de “side” zararlar var. Örneğin, sohbet robotu herhangi bir konuda bir makaleyi saniyeler içinde verimli bir şekilde yazabilir ve potansiyel olarak bir insan yazara olan ihtiyacı ortadan kaldırabilir. Chatbot ayrıca saniyeler içinde eksiksiz bir makale yazabilir, bu da öğrencilerin kopya çekmesini veya düzgün yazmayı öğrenmekten kaçınmasına sebep olabilir.

❌ ChatGPT'nin kusurları neler?

Çok etkileyici olsa da ChatGPT'nin de sınırları var. Mesela kimi cümle düzenlerini algılayamıyor. Kulağa makul gelen ancak pratikte anlam ifade etmeyen aşırı detaylı yanıtlar alabiliyorsunuz. Diğer taraftan belirsiz sorular hakkında açıklama istemek yerine, yalnızca sorunuzun ne anlama geldiğine dair bir tahminde bulunuyor.

Hatta bu durum developerların soru-cevap sitesi StackOverflow'un ChatGPT tarafından oluşturulan yanıtları geçici olarak yasaklamasına yol açtı.

👩🏼⚖️ Regülatörler ne diyor?

Yapay zeka ürünlerinde ABD ve Çin kapışıyor. Ancak Centre for the Governance of AI geçen sene “The Brussels Effect and Artificial Intelligence” raporu ile AB’nin yapay zekâ kanun tasarısının küresel etkisini tartışmıştı. Rapor, AB regülasyonlarının dünya standartları üzerinde olduğunu ve ABD ile Çin’inkilerden daha etkili olabileceğini iddia ediyor. Bu sebeple bu sayılık sadece AB regülasyonlarında ChatGPT’nin yerine bakalım.

🇪🇺 AB Yapay Zeka Taslak Kanunu temelde 4 risk kategorisi etrafında yapılandırılmış karmaşık bir “ürün güvenliği çerçevesi” sunuyor. Bu kritiklik piramidine dayalı risk temelli yaklaşımı katmanlı bir yaptırım mekanizmasıyla birleştiriyor.

Bu piramide referansla öngörülen yaptırımların uygulamaya geçebilmesi için AB düzeyinde yeni bir icra organının kurulması öngörülüyor, Avrupa Yapay Zekâ Kurulu (EAIB). Üye devlet düzeyinde, EAIB, GDPR’ın gözetim mekanizmasına benzer şekilde ulusal denetçiler de olacak. Bu sayede piramidin risk bazlı olarak belirlediği kuralların ihlaline ilişkin para cezası bu otorite tarafından belirlenecek. Bu miktar küresel cironun %6'sına kadar veya özel kuruluşlar için 30 milyon avroya kadar çıkabilecek. Bu bağlamda piramidin ikinci katmanı aslında ChatGPT’ye referans veriyor.

Sınırlı riskli ürünlerde özel yükümlülükler:

Piramitte minimal riskli ürünlerin teşvik edilmesi daha sonra ise sınırlı riskli ürünlere özel yükümlülükler belirlenmesi var. Bu kategoriye giren yapay zekâ sistemlerinin tanımlayıcı özelliği, şeffaflık açısından belirli sorunları gündeme getirmeleri ve dolayısıyla özel ifşa yükümlülükleri gerektirmeleri. (Tam olarak yukarıda bahsettiğimiz “sorunlar”)

Bu tür özel şeffaflık gereksinimleri gerektiren üç tür teknoloji var: deep fake, insanlarla etkileşime girmesi amaçlanan yapay zekâ sistemleri ve yapay zekâ destekli duygu tanıma sistemleri/biyometrik sınıflandırma sistemleri.

👉🏻 Örneğin: AB düzenlemeleri yaşayan kişilere izledikleri videonun deep fake’e olup olmadığını, konuştuğu kişinin bir chatbot mu yoksa sesli asistana tabi olup olmadığını öğrenme hakkı veriyor.

📑 Ayın Raporu: State of AI 2022’e yakından bakalım

Hazır yapay zekâ demişken beş senedir yapay zekâ alanında en kapsamlı bilgilere ulaştığımız State of AI’ın 2022 sayısı yayımlandı, ona bakalım.

2022 Yapay Zeka Raporu; endüstri ve araştırma alanındaki önde gelen yapay zekâ uygulayıcıları tarafından inceleniyor.

Rapor beş farklı başlıktan oluşuyor

Araştırma: Teknolojik atılımlar ve yetenekleri.

Endüstri: Yapay zeka için ticari uygulama alanları ve iş üzerindeki etkisi.

Politika: Yapay zekanın düzenlenmesi, ekonomik sonuçları ve yapay zekanın gelişen jeopolitiği.

Güvenlik: Gelecekteki yüksek kapasiteli yapay zeka sistemlerinin bize getirebileceği katastrofik risklerin belirlenmesi ve hafifletilmesi.

Tahminler: (En sevdiğim kısım, rapor kendi tahminlerine yönelik her sene feedback veriyor).

👀 Mercek altında

2022 Raporundaki ana temaları:

Yeni kurulan bağımsız araştırma laboratuvarları, büyük laboratuvarların kapalı kaynak çıktılarını hızlıca açık hale getiriyor. Yapay zekâ araştırmalarının da elbette Elon gibi teknoloji dehalarının elinde merkezileşeceği dogmasına rağmen; düşük maliyet ve bilgi işlem erişimi, daha önce bilinmeyen küçük laboratuvarların son teknoloji araştırmalarında öne çıkmasına yol açtı. Bu arada, yapay zekâ donanımı, NVIDIA'ya güçlü bir şekilde konsolide olmaya devam ediyor.

Güvenlik, büyük yapay zekâ araştırma kuruluşları arasında farkındalık kazanıyor. Yapay zekâ güvenliği ana akım bir disiplin haline geliyor.

Çin-ABD yapay zekâ araştırmalarındaki fark açılmaya devam ediyor. Çin; gözetleme, özerklik, olay yeri anlayışı ve nesne algılama gibi güvenlik ve jeopolitik etkileri olan alanlarda önemli ölçüde liderdir.

Yapay zekâ güdümlü bilimsel araştırma, atılımlara yol açmaya devam ediyor, ancak veri sızıntısı gibi büyük metodolojik hataların daha fazla sorgulanması gerekiyor. Bilimde yapay zekâ atılımları devam etse de araştırmacılar, yapay zekâdaki metodolojik hataların bu disiplinlere sızabileceği konusunda uyarıda bulunuyor ve bu da yapay zekâ tabanlı bilimde kısmen veri sızıntısından kaynaklanan artan bir yeniden üretilebilirlik krizine yol açıyor.

🤭 Geçen senenin tahminleri ve çıktıları:

Bizi sosyal medyadan takip edin!

🌐 Linkedin: Lex Tech Consultancy.

Lex Tech ilk sayısında güzel bir içerikle okuyuculara merhaba diyor. Emeğinize sağlık. ChatGPT konusunda detaylı bir anlatım olmuş .Yolunuz açık olsun..